Qui suis-je ?

Qui suis-je ?

Je suis ingénieur spécialisé en Mathématiques Appliquées et Imagerie Médicale.

Voici une présentation détaillée de mes études et de mon parcours scolaire et professionel.

Scientific Computing and Imaging Institute

Le Scientific Computing and Imaging Institute a été crée en 1992 sous l’impulsion du Docteur Christopher R. Johnson, Professeur d'informatique et de bioingenierie.

Il s’agit d’un regroupement de laboratoires de recherche en imagerie médicale, en informatique et en visualisation. Le SCI Institute est hébergé dans les locaux de l'Université d’Utah à Salt Lake City. L’ensemble des différents laboratoires est finances par divers organismes privés ou publics tels que la National Science Foundation ou le National Institute of Health. Il emploie environ 200 personnes dont une grande majorité sont des étudiants de tous niveaux qui participent aux nombreux projets de recherche et de développement. La grande force du SCI Institute repose sur les très nombreux partenariats qu’il a avec différents laboratoires et entreprises américaines mais aussi internationales. Ce qui leur permet de développer des logiciels performants et qui répondent aux attentes et exigences des professionnels.

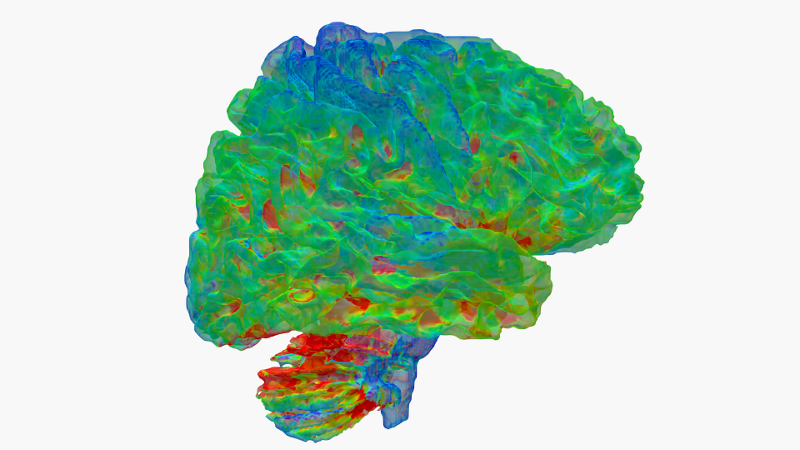

J’ai intégré le laboratoire d’imagerie médicale du Docteur Gerig en Juillet 2011. Ce laboratoire est composé d’une douzaine d'étudiants travaillant sur différentes problématiques d’imagerie médicale. Le docteur Gerig a obtenu un doctorat d'ingénierie électronique du Swiss Federal Institute of Technology avant de commencer des recherches en imagerie cérébrale. Il est depuis plus d’une vingtaine d'années un expert reconnu dans ce domaine.

Les différents projets que j'ai réalisé et ou j'ai été impliqué sont financés et soutenu par le National Institute Of Health.

Projets de recherche

➟ Imagerie du tenseur de Diffusion : Incertitudes

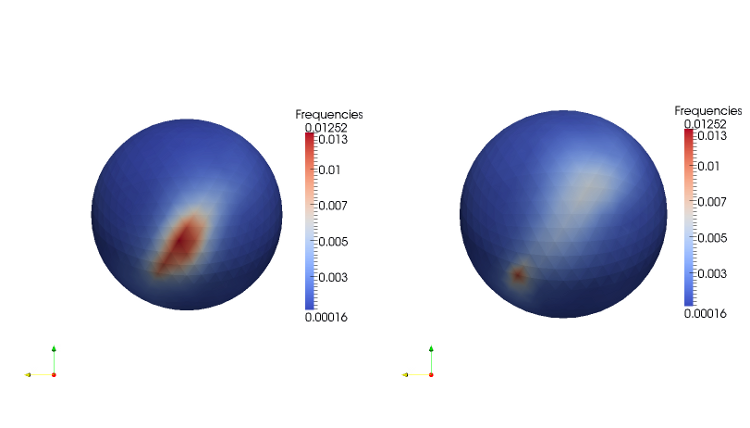

Quantification des incertitudes lors de la construction d'atlas puis de la tractographie

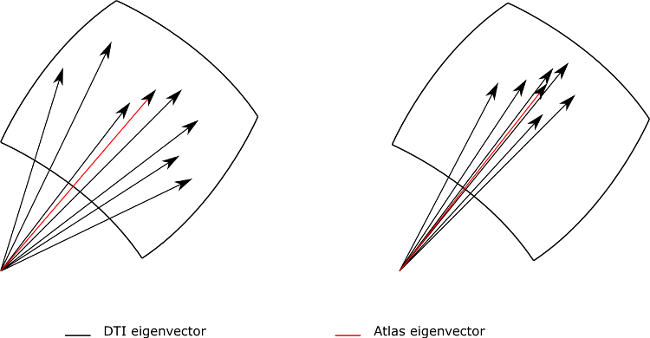

La construction d'atlas est un processus très utile pour pouvoir analyser et traiter une très grande quantité de données en utilisant une seule image intermédiaire. Ainsi donc, on peut étudier une région spécifique dans l'atlas et grâce à des transformations (diffeomorphismes) on peut extraire cette région dans l'ensemble des images composant l'atlas. Cette technique très fiable a néanmoins un défaut. En effet, l'atlas étant une image moyenne il existe une incertitude liée à la variabilité spécifique de chaque image qui se trouve mélangée avec les variabilités de toutes les autres images et ensuite moyennée en une unique variable.

L'objectif de ce projet est de quantifier la distribution de ces variabilités, qui entraînent une incertitude lors de la création de l'atlas. Cette analyse étant menée sur des images de diffusion (DTI) nous allons dans un premier temps approximer notre analyse à l'étude du vecteur propre principal porteur de la direction majeure de diffusion. Cette approximation nous permet de simplifier l'analyse Riemannienne de notre espace de travail en ramenant l'espace des tenseurs de diffusion (espace des matrices symétriques définies positives) à l'espace sphérique. Nous allons donc quantifier la distribution spatiale des vecteurs principaux, la première approximation étant l'analyse en composante principale (PCA) de la projection de ces vecteurs dans l'espace tangent au point moyen (obtenu par minimisation de la métrique Riemannienne sur la sphère).

Si le modèle simplifié ramene au vecteur propre principal devait ne pas suffire, nous nous ramenerions alors à l'étude de l'espace des tenseurs de diffusion.

Une fois une mesure de l'incertitude disponible nous tenterons de créer une visualisation liée à la visualisation classique d'une image de diffusion pour mettre en évidence cette incertitude. Nous pourrons utiliser une matrice de variance covariance que nous visualiserions telle un tenseur de diffusion ou alors nous exploiterions directement les vecteurs caractérisant la distribution spatiale pour paramétrer un glyphe.

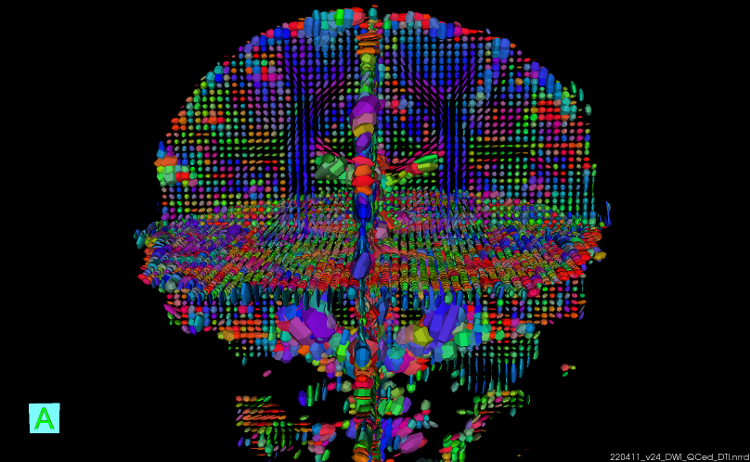

➟ Analyse qualité

Assurer la qualité des images utilisées dans les analyses

Nos précédentes recherches l'ayant montré, la qualité de nos données initiale est très fréquemment à l'origine de problèmes de recalage ou peut par la suite influer dans les analyses statistiques menées sur une population. La problématique de la qualité a été un aspect central de mon travail sur les images de diffusion ces deux dernières années.

Post vérification du projet sur les artefacts

Un nouveau set de données devrait être disponible bientôt et donc nous allons soumettre ces nouvelles données aux analyses d'entropie et de qualité des images de diffusion pour vérifier que les corrections apportées aux machines IRM de certains sites ont bien été fructueuses.

Ces données seront également intégrées dans la base de donnée d'images partagées pour permettre à toutes les personnes impliquées dans le projet de les consulter et de les analyser.

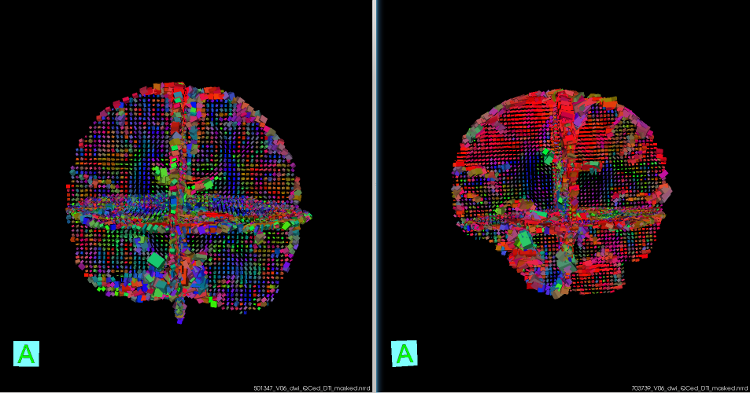

➟ Imagerie du tenseur de Diffusion : Entropie

Imagerie du tenseur de diffusion

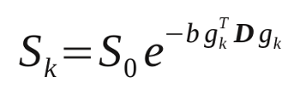

L'imagerie du tenseur de diffusion repose sur deux techniques : le DW MRI et le DT MRI. Ces techniques d’imagerie médicales sont utilisées pour étudier la diffusion de l’eau dans le cerveau. En effet, la molécule d’eau a, dans un environnement homogène, isotrope et en l’absence de toute contrainte, un mouvement erratique appelle mouvement Brownien. Or, le cerveau est composé de milliards de neurones connectés les uns aux autres par des connexions synaptiques. La diffusion de l’eau a donc lieu le long des gaines de myéline qui recouvrent les axones de ces neurones. Le mouvement de l’eau n’est donc ici plus isotrope car il va être contraint par les structures cérébrales constituées par les neurones. Ainsi, grâce à la technique d'acquisition pondérées on est capable de reconstruire la diffusion de l’eau dans le cerveau. Cette technique : le Diffusion Weighted Imaging acquiert différentes images en modifiant pour chacune l'intensité du champ magnétique appliqué et l’orientation de ce champ. Ainsi grâce, à ces différentes images et a la relation établie par Stejskal et Tanner concernant le modèle de diffusion, on est en mesure de produire pour chaque voxel du cerveau un tenseur de diffusion.

Grâce a cette équation et les images a champs pondéré acquises ont est en mesure d'estimer la matrice de diffusion D contenu dans la précédente équation. Ainsi sachant que cette matrice est symétrique il faut au minimum 6 équations provenant de 6 images pour l'estimer. Néanmoins pour des raisons de précision le protocole utilisé dans le cadre du DTI comporte une séquence d'acquisition de 25 images.

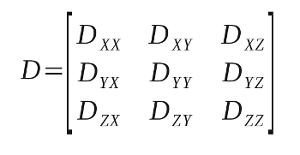

On produit donc ainsi une image appelée tenseur de diffusion. Pour pouvoir visualiser la diffusion, on réalise une analyse en composantes principales (PCA) du tenseur en chaque point ce qui permet de déterminer les caractéristiques de la diffusion au travers de ses valeurs et vecteurs propres. On obtient donc ainsi les directions de diffusion de l’eau. En utilisant une représentation tridimensionnelle de ses caractéristique, on peut visualiser des tenseurs de diffusion et les analyser.

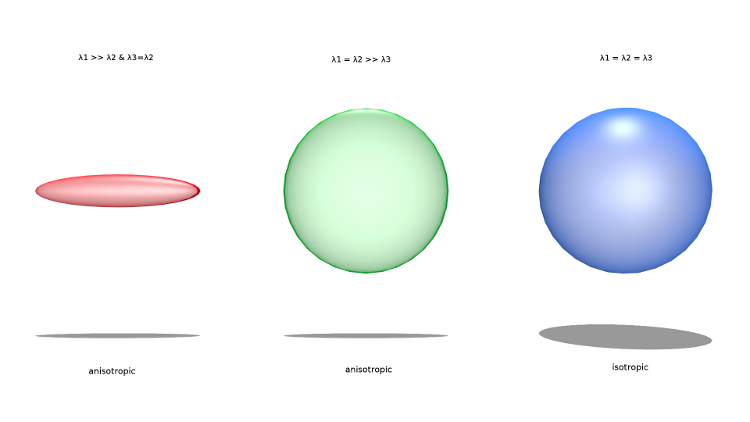

Ainsi, en utilisant cette technique pour chaque voxel on est alors en mesure de produire l'image de diffusion qui représente pour chaque voxel la diffusion encodée par le tenseur associé.

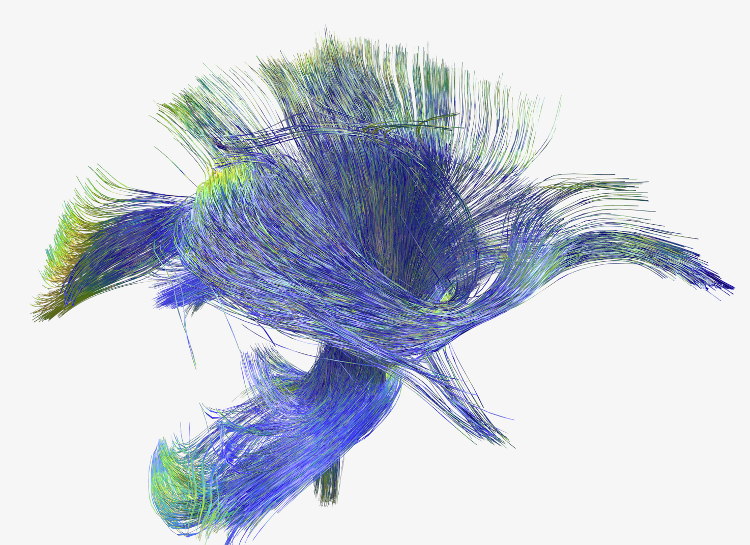

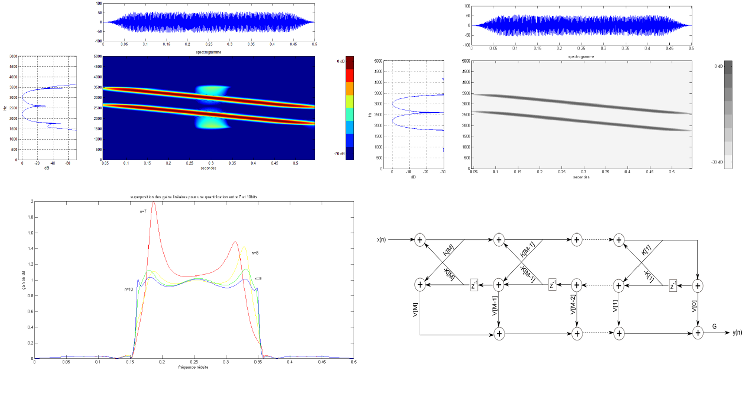

Entropie d'une image de diffusion

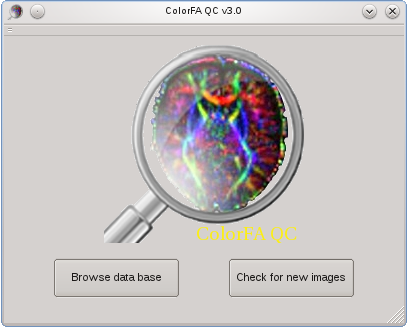

Lors de nos différentes études de qualité des données nous avons pu mettre en évidence la présence d'un artefact directionel qualifié d'artefact rouge en raison de son influence latérale sur l'orientation des glyphes de diffusion qui arborent alors une couleur rouge. Cet artefact directionnel peut être assez simplement quantifié en calculant l'entropie du champ vectoriel du vecteur propre principal porteur de l'orientation majeure de la diffusion. Cette mesure d'entropie permet par introduction d'une valeur normale de détecter par comparaison un possible artefact.

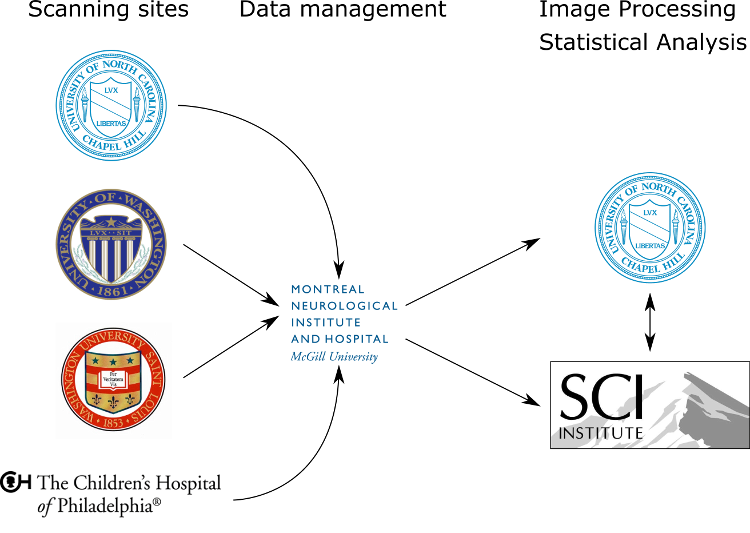

Ce projet a été mené en parallèle avec un autre groupe de recherche de l'Université de Caroline du Nord à Chapel Hill (UNC) qui a implémenté un logiciel de visualisation associé au calcul d'entropie.

L'utilisation de l'entropie comme unique valeur dérivée permetant de quantifier un possible artefact a grandement simplifié les analyse de qualité permetant une discrimination plus rapide de mauvais cas et ouvrant la voie a une detection automatique.

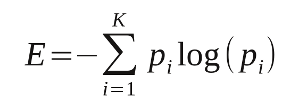

➟ Tractographie cérébrale

Extraction des réseaux de neurones

La tractographie est une technique utilisée pour reconstruire les connexions et réseaux de neurones de la matière blanche grâce aux informations de diffusion contenues dans l'image de diffusion. Grâce à l'information de diffusion de l'eau contenue dans chaque voxel par le tenseur de diffusion il est possible de définir une région d'intérêt et de calculer l'ensemble des fibres qui passent par cette région ou y arrivent. On peut donc obtenir des groupes de fibres sur lesquelles on peut mener des analyses statistiques de la diffusion.

Analyse longitudinale

Les données IRM sur lesquelles nous travaillons sont constituées d'un ensemble d'acquisitions IRM de plusieurs bébés dans le temps. L'avantage de réaliser ces acquisitions dans le temps est que nous pouvons étudier l'évolution de très nombreux paramètres lors de la croissance du cerveau du bébé et en particulier grâce à la tractographie qui va nous fournir une évolution de la diffusivité de l'eau le long des fibres nerveuses et donc illustrer le développement et l'augmentation de densité de celles-ci. Il est donc possible de considérer une région particulière du cerveau et d'obtenir les courbes d'évolution de la diffusivité. Dans de récentes publications, il nous a été possible de noter des comportements étranges de certaines de ces courbes, allant parfois à l'encontre de certains principes empiriques prouvés et validés.

➟ Contrôle qualité

Mise en évidence d'artefacts

Lors de nos analyses statistiques sur des résultats de tractographie, nous nous sommes rendu compte que nous obtenions systématiquement quelque soit le groupe de fibres que nous analysions, des cas avec des comportements marginaux. Ces cas étant assez rares ils avaient auparavant été extraits de l'analyse statistique mais aucune investigation plus profonde n'avait été entreprise. De plus, dans certains articles ou certains papiers, il était possible de voir des courbes d'évolution de la diffusion dans le cerveau au cours du temps avec des comportements inattendus. Cela a donc contribué à entreprendre ce projet pour caractériser et comprendre l'origine de ces comportements étranges et si possible les corriger.

Les courbes d'analyse statistiques étant des données dérivées de haut niveau comparées a nos données de base qui sont constituées de la séquence IRM acquise par la machine il a donc été nécessaire de reparcourir toutes les étapes de notre processus ayant contribué à produire ces courbes pour localiser un potentiel problème.

Ces courbes étant générées via les différentes tractographies que nous faisions, nous avons donc vérifié chaque tractographie et nous avons pu en comparant les courbes issues de la tractographie à celles dérivées par l'analyse statistique, nous rendre compte que cette étape n'était pas responsable du problème.

Nous sommes donc retourné aux données sur lesquelles la tractographie s'appuie à savoir les images de diffusion(DTI) et nous avons entrepris une étude minutieuse de celles-ci. Et nous avons pu constater qu'une grande partie de celle ci présentaient une étrange coloration rouge.

Une fois cet artefact mis en évidence sur nos données de travail (les DTI) une grande question a surgi. En effet, il convenait de savoir si l'estimation des ces images grâce à l'ensemble des DWIs était incorrect ou si c'était le set de DWI qui avait un problème d'acquisition. Il est clair que la première solution était la plus espérée car cela impliquait une erreur de traitement donc une possibilité de correction et donc que l'intégrité des données initiales n'était pas en cause. Mais, un point restait gênant avec cette hypothèse. En effet, s'il s'agissait d'un problème d'estimation des images pourquoi certaines seulement étaient concernées alors que toutes étaient traitées de la même manière ? Néanmoins, nous avons mené l'investigation dans cette direction car les enjeux (financiers majoritairement) liés à l'acquisition de ces données nous poussaient à espérer que cette hypothèse était la bonne. Malheureusement, ce ne fut pas le cas. Après avoir vérifié la théorie et l'implémentation, il est apparu que l'acquisition des données était en jeu.

Cependant, nous n'avons pas cédé au fatalisme et nous nous sommes orientés vers la recherche d'une méthode de correction des données présentant cet artefact dans le but de les rendre plus exploitable en réduisant l'influence de l'artefact.

Dans ce protocole, l'estimation du DTI repose sur un ensemble d'images IRM à intensité du champ magnétique pondéré et à orientation variable. Nous avons donc tenté une approche Leave One Out (LOO) ou nous avons ré estimé l'image de diffusion en excluant tour à tour une image pondérée. Cela nous a permis de mettre en évidence l'influence forte d'une des directions d'acquisition et donc nous avons pu, en utilisant l'analyse d'entropie du tenseur, établir une réduction significative de l'artefact par exclusion de cette direction lors de l'estimation.

Une analyse statistique a été menée en fonction du site d'acquisition des images et a mis en évidence certains sites générant la majorité de ces images. Ainsi, il a été possible de fournir aux radiologues, en plus des images, des illustrations numériques qui ont donné lieu à des améliorations des machines utilisées pour ces scans. Ce projet a également permis de mettre en place une base commune d'images indépendante des conditions de travail de chacun, permettant une analyse conjointe et indépendante de l'accès à la base de données originales.

➟ Visualisation de "Large Data Set"

Partager des données avec d'autres laboratoires

Les données sur lesquelles nous travaillons proviennent d'une base de données de plusieurs milliers d'IRM de bébés dans le cadre d'une étude sur le développement de l'autisme chez les nouveaux nés. En raison des protocoles utilisés, initialement DTI puis maintenant HARDI, les quantités de données acquises et stockées sont très importantes. Il est donc nécessaire de générer des données dérivées moins volumineuses, plus pertinentes et résumant les analyses que nous menons. C'est le cas des images d'anisotropie fractionnelle et de sa dérivée (la curvatureFA) qui permettent d'analyser rapidement la qualité d'une acquisition sans devoir visualiser l'image de diffusion qui est très volumineuse et souvent moins facile à analyser.

Dans le cadre du projet de recherche sur l'étude des artefacts directionnels mené avec UNC, nous avons été amenés à échanger des données et collaborer avec des radiologues, des analystes et des statisticiens qui n'avaient pas forcément les outils et les connaissances pour travailler avec des images de diffusion. Il a donc été nécessaire de dériver les images adéquates pour permettre à toutes ces personnes de travailler sur les mêmes données et d'avoir une analyse commune.

Les différents sites impliqués

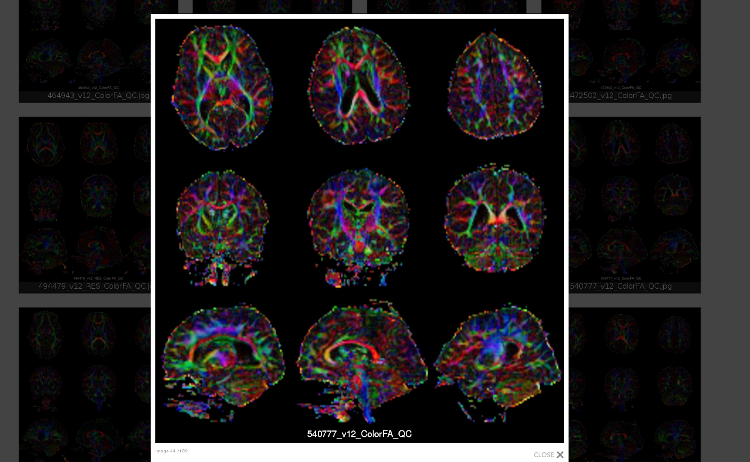

Le choix des images d'anisotropie fractionnelle colorées par la direction principale de diffusion est donc apparu comme la meilleure solution en raison de la caractéristique de cet artefact qui confère à ces images une coloration rouge. Nous avons ensuite développé un pipeline pour générer ces images et extraire des sections intéressantes et les composer entre elles.

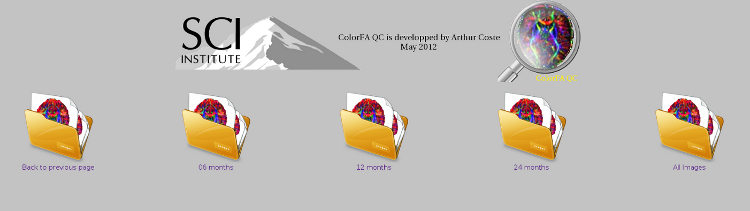

Interface pour choisir l'age des sujets.

Visualisation d'une mosaic

La problématique de l'analyse conjointe par des personnes d'horizon et de formation différents a été résolue en utilisant une visualisation simple d'images basée sur un viewer en ligne. Ainsi, nous avons pu assurer que toutes les personnes impliquées puissent voir les données et ce, quelque soit leur support de connexion (ordinateur / tablettes / smart-phone) ou leur système d'exploitation.

➟ Construction d'atlas

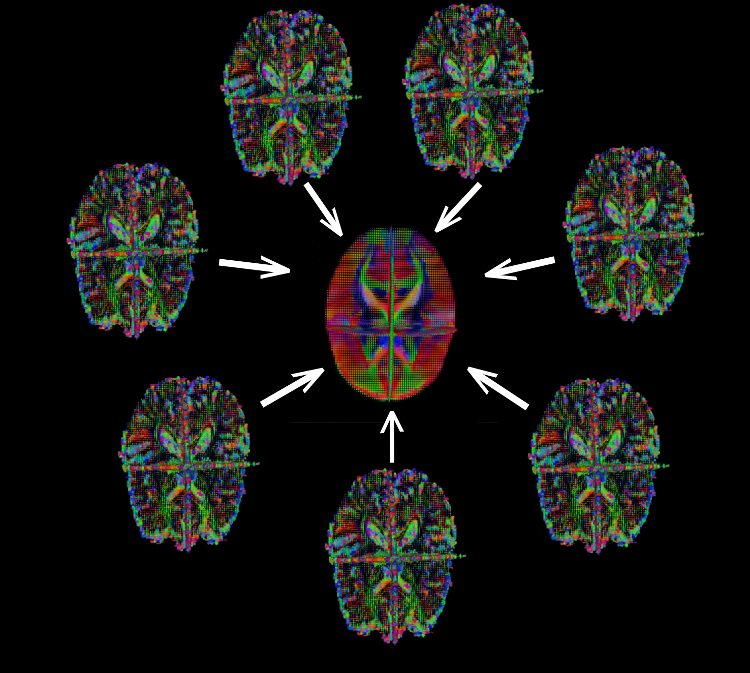

Une image representant une population

En imagerie médicale, le recours à la construction d'un atlas est une technique courante pour étudier facilement la variabilité intra population aussi bien que les différences entre les cas composants cette population. Il existe donc en imagerie cérébrale un procédé permettant de donner à toutes les images acquises pour une population donnée le même système de coordonnées. Cette technique repose sur une transformation difféomorphique entre les différents espaces de coordonnées qui permet, par optimisation, de déterminer une transformation optimale pour toutes les images. Une fois toutes ces images recalées entre elles, on peut calculer une image moyenne qui est appelée un atlas.

La problématique de la moyenne

Dans le cadre de notre étude, les différentes images que nous acquérons puis traitons sont acquises chez des sujets d'âges différents. Cela implique donc des états de développement des structures cérébrales différents. Ainsi, lorsque l'on recale et que l'on moyenne toutes ces images pour créer un atlas, il devient difficilement possible d'estimer l'état de développement des structures cérébrales représentées. Il a donc été nécessaire de repenser le protocole de construction d'atlas. Cette étude sera approfondie et reprise lors de nos recherches sur la qualité d'un atlas car nous pensons que cet aspect peut également influer sur la qualité générale de l'atlas obtenu. Notre objectif étant de comparer les mesures de qualité d'atlas entre les différentes constructions de ce dernier que nous essaierons.Présentations

➟ Séminaire d'Imagerie Médicale

Presentation

➟ Présentation étudiants Utah

Presentation

➟ Présentation étudiants CPE

Presentation

University of Utah

Lors de ma césure au SCI Institute, le Dr Gerig m'a proposé de rester une année supplémentaire pour pouvoir poursuivre les différents projets de recherche que je menais et pouvoir continuer à profiter de l'expérience et des connaissances que je developpais au sein du laboratoire.

Pour pouvoir rester et obtenir également mon diplome d'Ingénieur en Electronique Télécommunications et Informatique, j'ai décidé de finir mon cursus au sein de la School Of Computing de l'université d'Utah. Cette année universitaire me permettant d'étudier des matières non enseignées à CPE Lyon mais aussi de rester impliqué dans une activité de recherche.

Voici une présentation des divers cours que j'ai suivi ou auxquels j'ai assisté en auditeur libre.

Semestre de Primtemps 2013

➟ Vision 3D par ordinateur

3D Computer Vision CS6320

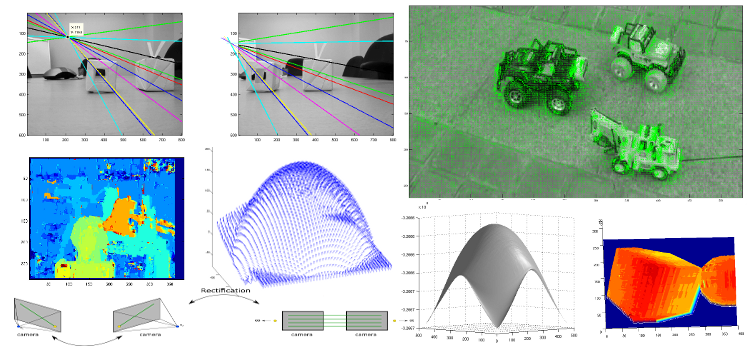

Ce cours traite des notions relatives à l'acquisition d'images à l'aide de caméra ou de capteurs. Il aborde les différents traitements que l'on peut faire avec ces acquistions pour extraire les caractéristiques physiques de la scène observée et des objets la composant. Voici une description des projets réalisés pour ce cours, chaque projet a donné lieu à une implémentation réalisée avec Matlab et un rapport contenant des analyses théoriques et une mise en application.

Projet 1 : Calibration de Caméra. Dans ce projet nous avons mis en place le modèle mathématique relatif à la détermination des paramètres physiques de notre appareil photos (paramètres du capteur CCD) et des paramètres spatiaux c'est à dire sa position et son orientation par rapport a notre objet.

Projet 2 : Stéréoscopie. Reconstruction de la profondeur, determination des lignes épipolaires et des épipoles sur une paire d'images. Détermination de la disparité et de la carte de distance avec deux images rectifiées.

Projet 3 : "Shape from Shading" : Reconstruction de la structure d'un objet à l'aide de plusieurs images ou la position de la source lumineuse change. Etude des surfaces Lambertiennes et des cartes de reflectance.

Projet 4 : "Flux optique et lumière structurée" : Estimation du mouvement des objets entre "frames" d'une séquence video. Etude de distances et propriétés des objets par utilisation de lumière structurée (grilles-motifs)

Projet 5 : "Multiple Baseline Stereo" : Reconstruction d'objets et de profondeur d'une scene utilisant plusieurs caméras allignées ou la translation d'une camera. Référence : M. Okutomi, T. Kanade, A Multiple Baseline Stereo.

➟ Modélisation Probabiliste

Probabilistic Modeling CS6957

Utilisation de la théorie des probabilités pour modéliser et analyser des données provenant du monde extérieur et qui introduisent des incertitudes. Il faut donc pouvoir modéliser le bruit d'acquisition, les informations manquantes ou erronées et le fait que nos données ne sont que des échantillons pris dans une population. C'est pourquoi, le modèle probabiliste est une approche effective pour intégrer une possible connaissance à priori de notre modèle. Les applications de ces techniques sont omniprésentes dans les sciences informatiques et reposent sur l'apprentissage automatique du modèle par les ordinateurs.

Thèmes abordés : Estimation du maximum de vraissemblance (MLE), Inférence Bayesienne, estimation a priori, distribution a priori, familles exponentielles, Densite a priori d'entropie maximale, Modèles multivariés, Regression linéaire Bayesienne, Modeles Graphiques et Reseaux Bayesiens, Champs aléatoires de Markov, Méthode de Monte-Carlo, Markov chain Monte Carlo, Algorithme de Metropolis-Hastings, Échantillonnage de Gibbs.

➟ Séminaires d'Imagerie Médicale

Medical Imaging Seminar CS7938

Ensemble de séminaires traitant de différentes techniques d'imagerie médicale et de traitement de ces images. Ces séminaires comprennent des présentations d'étudiants, de chercheurs, des entrainements pour des conférences, des séminaires réalisés par des PIs (Principal Investigator) et des présentations d'invités d'autres départements, universités ou laboratoires américains ou internationaux.

Voici quelques présentations remarquables auxquelles j'ai eu la chance d'assister:

Daniel Rueckert, Imperial College London, UK : Machine learning meets medical Imaging

Semestre d'Automne 2012

➟ Traitement d'images

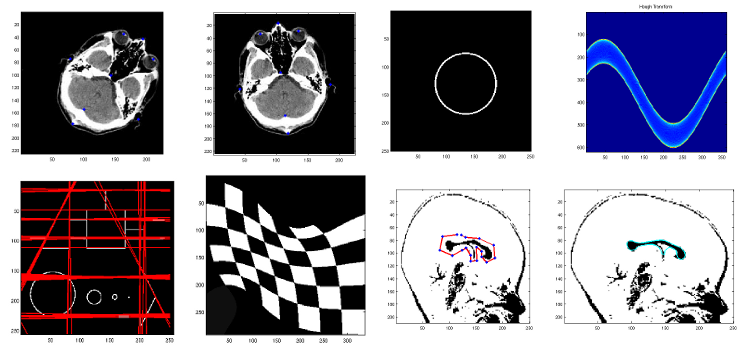

Image Processing CS6640

Ce cours aborde les techniques élémentaires de traitement d'images. L'étude et les transformations d'histogrammes, les opérations sur les images, les opérateurs basiques, le filtrage spatial et fréquentiel, la transformée de Hough, le recalage d'images (registration), les contours actifs et la morphologie mathématique.

Projet 1 : Histogrammes. Génération des histogrammes, normalisation, égalisation et blending.

Projet 2 : Filtrage. Filtrage spatial, Gaussien, détection de lignes, détection de formes.

Projet 3 : Transformée de Hough pour la détection de lignes.

Projet 4 : Recalage affine d'image, recalage avec fonctions radiales (RBF).

Projet 5 : Contours actifs : Implémentation du snake par le calcul des variations.

➟ Visualisation Scientifique

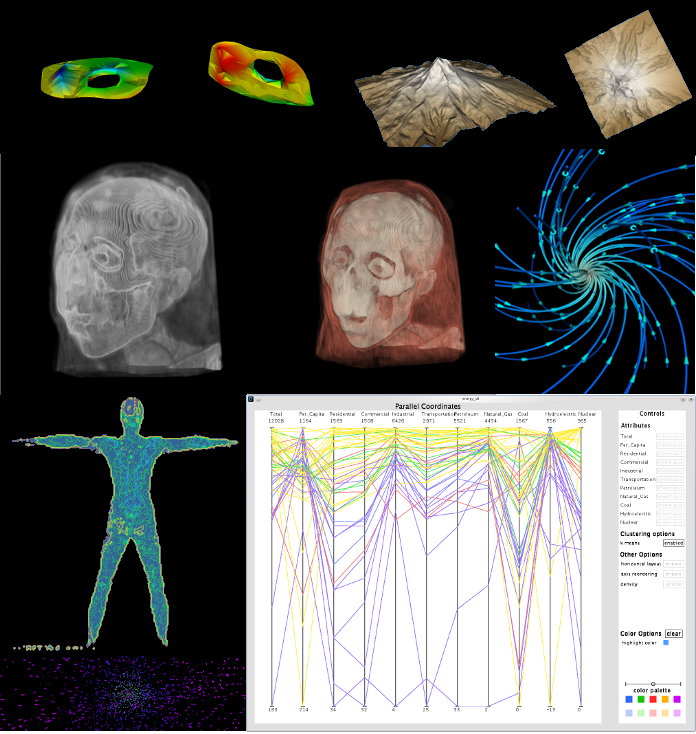

Scientific Visualization CS6630

Ce cours introductif aux techniques de visualisations m'a permis de me familiariser avec les outils informatiques et le vocabulaire relatif à la représentation de données. Une premiere partie du cours a été consacrée aux données non scientifiques pouvant être extraites depuis des bases de données qu'il faut traiter pour pouvoir les exploiter. Les concepts principaux relatifs au choix et à la gestion des attributs ont été très utiles pour appréhender la réduction de dimensions sans perte d'informations par l'introduction d'attributs dérivés.

Projet 3 : Implémentation d'un logiciel de visualisation de coordonnées parallèles avec Processing.

Projet 4 : Visualisation de données Spatiales 2D avec VTK et Python.

Projet 5 : Visualisation de données Spatiales 3D avec VTK et Python.

Projet 6 : Visualisation de champs vectoriels avec VTK et Python.

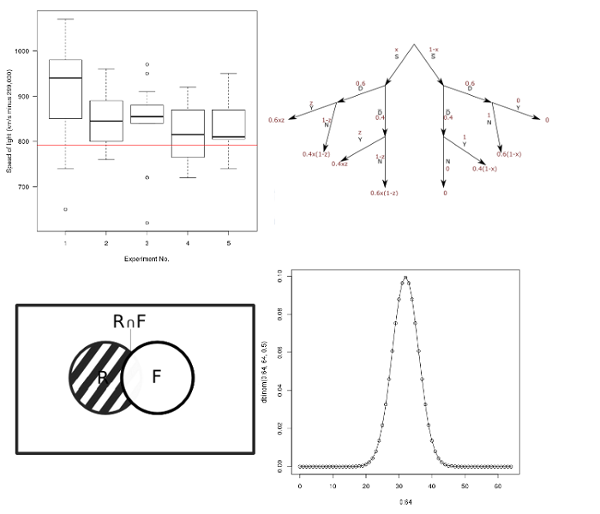

➟ Probabilités et Statistiques

Probabilities and Statistics CS3130

Cours de probabilités discrètes et continues, bases de probabilités, théorème de Bayes, Variables aléatoires, estimation, intervalle de confiance, distributions classiques, theorème de De Moive-Laplace, theorème Central Limite, lois multivariées.

➟ Séminaires d'Imagerie Médicale

Medical Imaging Seminar CS7938

Ensemble de séminaires traitant de différentes techniques d'imagerie médicale et de traitement de ces images. Ces séminaire comprennent des présentation d'étudiants, de chercheurs, des entrainements pour des conférences, des séminaires réalisés par des PIs (Principal Investigator) et des présentations d'invités d'autres départements, universités ou laboratoires américains ou internationaux.

J'ai réalisé une présentation dans le cadre de ce séminaire le lundi 10 septembre 2012.

Présentation

➟ Séminaires de Visualisation

Visualization Seminar CS7942

Ensemble de séminaires traitant de visualisation d'informations ou de visualisation scientifique. Ces séminaire comprennent des présentation d'étudiants, de chercheurs, des entrainements pour des conférences, des séminaires réalisés par des PIs (Principal Investigator) et des présentations d'invités d'autres départements, universités ou laboratoires américains ou internationaux.

Semestre de Primptemps 2012

➟ Geométrie Riemannienne

Introduction to Riemannian Manifolds CS7931

Métriques Riemanniennes, Connections affines et Riemanniennes, Géodésiques.

➟ Séminaires d'Imagerie Médicale

Medical Imaging Seminar CS7938

Ensemble de séminaires traitant de différentes techniques d'imagerie médicale et de traitement de ces images. Ces séminaire comprennent des présentation d'étudiants, de chercheurs, des entrainements pour des conférences, des séminaires réalisés par des PIs (Principal Investigator) et des présentations d'invités d'autres départements, universités ou laboratoires américains ou internationaux.

➟ Séminaires de Visualisation

Visualization Seminar CS7942

Ensemble de séminaires traitant de visualisation d'informations ou de visualisation scientifique. Ces séminaire comprennent des présentation d'étudiants, de chercheurs, des entrainements pour des conférences, des séminaires réalisés par des PIs (Principal Investigator) et des présentations d'invités d'autres départements, universités ou laboratoires américains ou internationaux.

CPE Lyon

Suite à l'obtention avec mention en 2007 de mon baccalauréat Scientifique Européen j'ai été admis en classes préparatoires de l'Institution des Chartreux à Lyon. J'ai fait ma première année de Maths supérieures en MPSI puis ma seconde année de Maths spéciales en PSI.

En 2009, après deux ans de classes préparatoires j'ai été admis dans le département Electronique Télécommunication et Informatique (ETI) de l'Ecole Supérieure de Chimie Physique et Electronique de Lyon (ESCPE Lyon).

Voici une présentation des cours que j'ai suivis à CPE Lyon entre 2009 et 2011

Seconde année

➟ Modules de Spécialisation

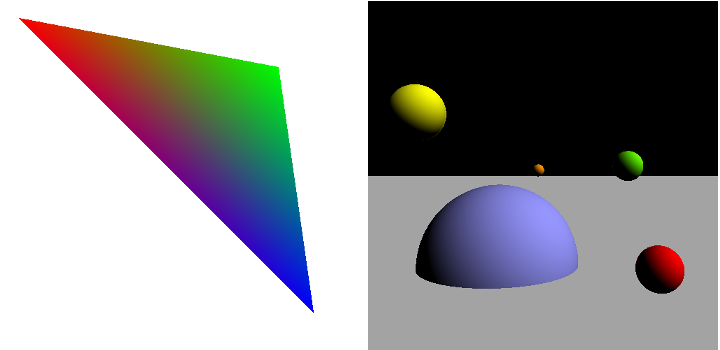

Synthèse d'images

Etude de l'algorithme de Bresenham, des techniques de rendu graphique, Eclairement de Phong.

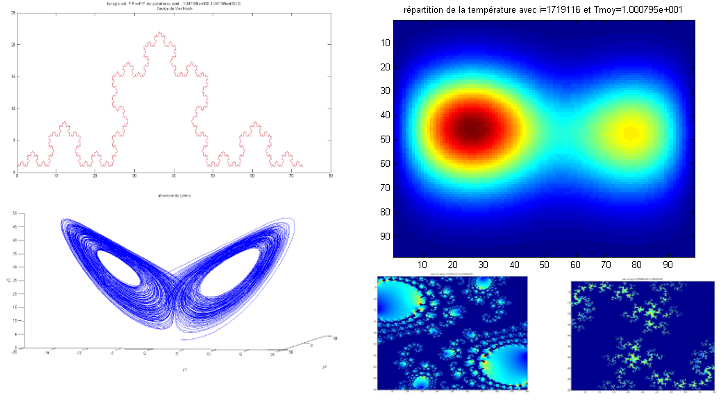

Outils mathématiques pour l'informatique et la modélisation

Etudes de certains algorithmes de tri, stratégie "divide and conquer", Morphologie mathématique, Théorie fractale et ensembles de Julia, méthode de Monte Carlo, Automates cellulaires, Récursivité, Systèmes de Lindemayer, Diffusion thermique, Logique et language de programmation Prolog, étude des attracteurs.

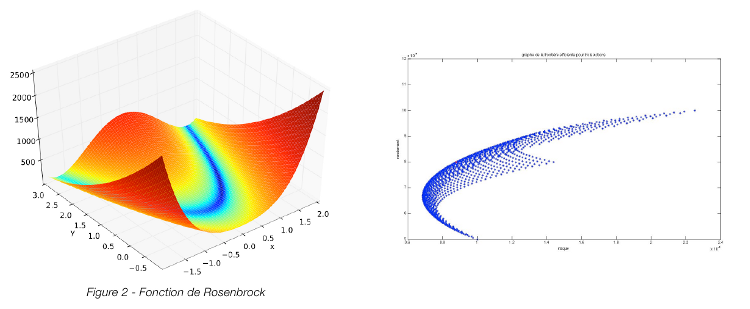

Techniques d'optimisation

Méthode du simplexe, algorithmes BFGS et KKT, optimisation boursière.

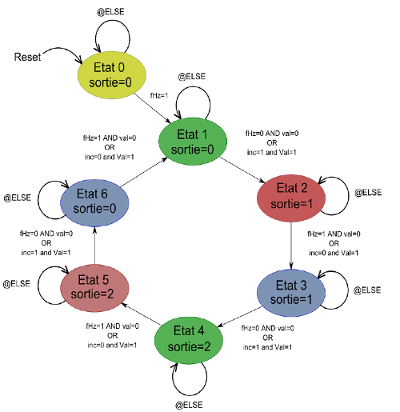

Filtrage numérique

Etude des filtres numériques et implémentations. Filtres à réponse impulsionnelle finie à phase linéaire, filtre à réponse impulsionelle infinie, synthèse à oscillations controlées, structure des filtres numériques pour DSP.

➟ Modules Scientifiques communs

Systèmes d'exploitation

Fonctions basiques des systèmes d'exploitations UNIX, gestion de processus, implémentation multithread, sémaphores.

Electronique Numérique Avancée

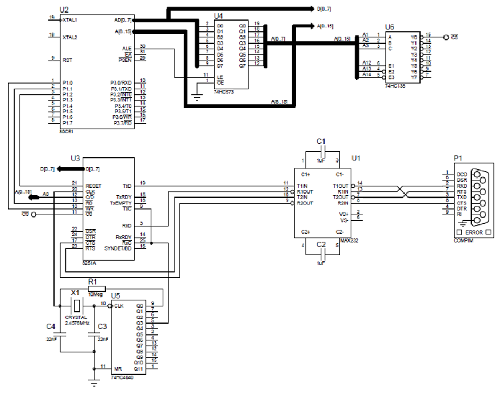

Synthèse de compteurs numériques, VHDL

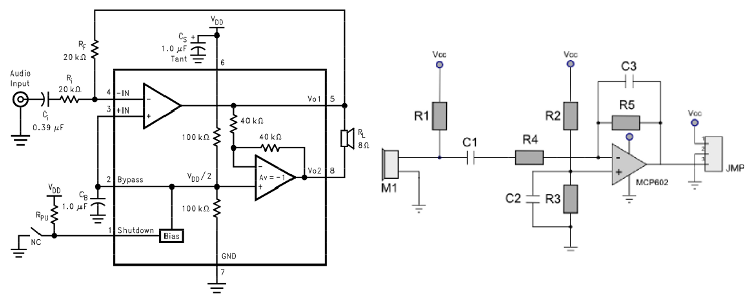

Fonctions Analogiques et fonctions Analogiques Complexes

Filtrage analogique, systèmes à boucle de phase, Conversion Analogique Numérique et Numérique Analogique.

Systèmes à Microprocesseurs

Architecture interne des microprocesseurs et intégration dans des systèmes complexes. Programmation Assembleur.

Traitement numérique du signal, Traitement des signaux aléatoires

Synthèse de filtres numériques, numérisation de signaux, conversion analogique numérique. Modélisation du bruit et filtrage.

➟ Modules Non Scientifiques

Techniques et outils de management

Module de civilisation et pratique de l'anglais

L'anglais en entreprise & Culture et Histoire Américaine

Module de civilisation et pratique de l'espagnol

L'espagnol en environnement professionel & culture cinématographique espagnole

Première année

➟ Modules Scientifiques communs

Programmation en C/C++

Electronique Analogique, Numérique, de Puissance et Electrotechnique

Traitement du signal et systèmes linéaires

Mécanique quantique et physique des matériaux semiconducteurs

➟ Modules Non Scientifiques

Projet de création d'entreprise : Electreecity

Dans le cadre du projet de création d'entreprise de CPE Lyon mais également de Campus Création qui est un concours entreprenarial Lyonnais, nous avons formé un groupe avec des étudiants de CPE et de l'Université de Lyon. Nous avons ensuite effectué toutes les étapes de développement d'une entreprise et du développement des produits et stratégies marketing et commerciales.

Vainqueur du Grand Prix Campus Création 2010

Analyse économique et socioproductive

Module de civilisation et pratique de l'anglais

Module de civilisation et pratique de l'espagnol

BioClinica

J'ai effectué mon Projet de Fin d'Etudes chez BioClinica ou j'ai travaillé pendant 7 mois sur 3 projets différents : de la correction de biais d'acquisition d'images IRM de l'abdomen, le developpement d'un environnement de mesure d'épaisseur corticale dans le cadre de la maladie d'Alzheimer et un projet de recherche en segmentation des tissus cérébraux utilisant le multi atlas, les probabilités et l'information a priori.

Autres Compétences

Voici d'autres compétences que je possède ou suis en train d'acquérir ou de développer.

Informatique

Languages de Programmation

C/C++, Linux Shell, tcsh, Python, Processing, Qt, HTML, CSS, SQL/MySQL, Cmake, Git, Mercurial, Matlab, R, ITK, VTK

Logiciels

Microsoft office/Open Office, Matlab, Gestion de sites web, Administration de bases de données, Paraview, Blender, LateX

Environemments

Windows NT, Linux Ubuntu and OpenSuse, Mac OS X

Langues

Francais : langue maternelle

Anglais : fluide (Cambridge First Certificate of English en 2007 et TOIC en 2009 score 870), TOEFL iBT 109/120 (Mars 2012)

Espagnol : niveau standard pour la conversation courante et la vie quotidienne

Références

Joel Schaerer PhD : Superviseur de Recherche chez BioClinica

Guido Gerig PhD : Mentor au SCI Institute :

Lettre de recommandation

Jean Marie Becker PhD : Mentor à CPE Lyon :

Distinctions

Dean List Designation, University of Utah : 4.0 GPA

Grand Prix Campus Création 2010